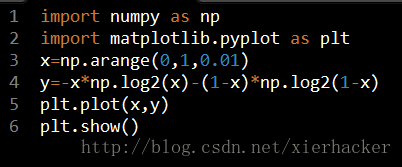

, e p8 E+ a1 H0 e# L

, e p8 E+ a1 H0 e# L ( q$ J8 M- O6 I

( q$ J8 M- O6 I

: s+ x7 e |- F/ l6 y( u

: s+ x7 e |- F/ l6 y( u % B+ \8 X' }. @ q7 c

% B+ \8 X' }. @ q7 c

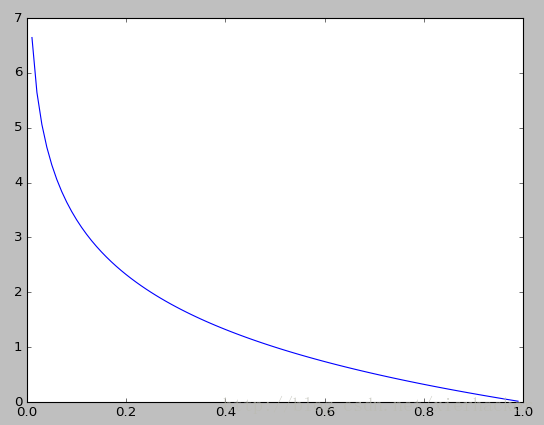

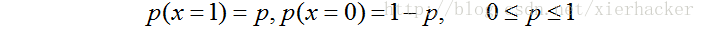

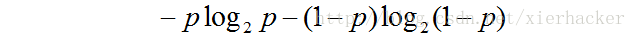

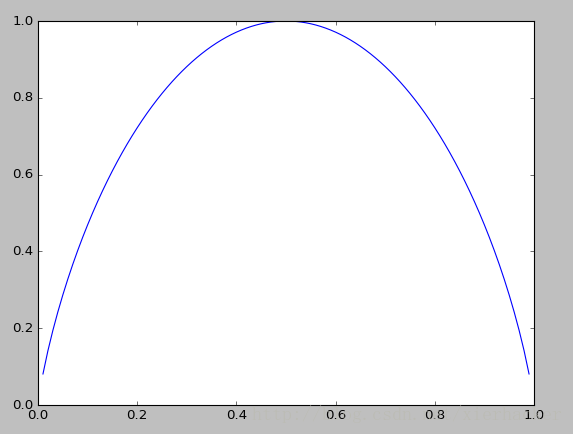

从图中可以知道:

1.当p=0或者p=1的时候,随机变量可以认为是没有不确定性.

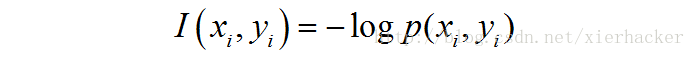

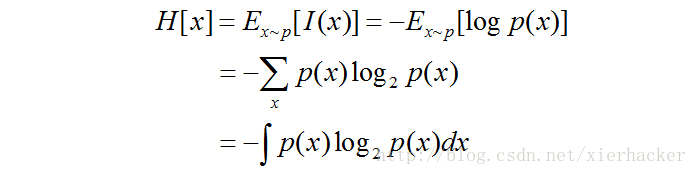

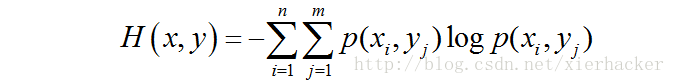

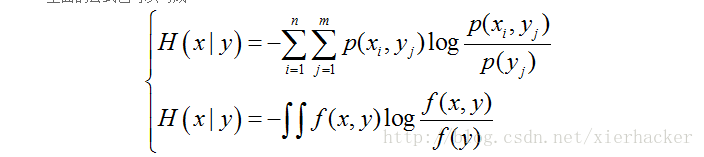

同样,复合熵的公式还可以推广到连续变量和多个变量的情况。这里就不写了。

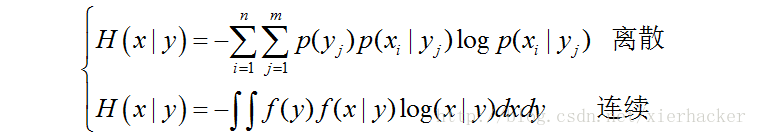

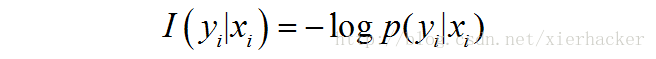

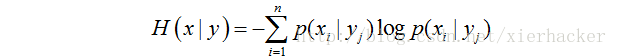

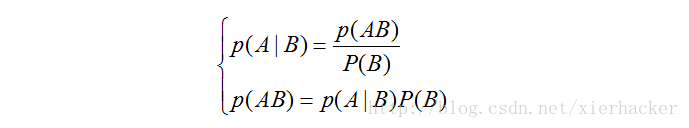

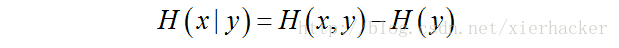

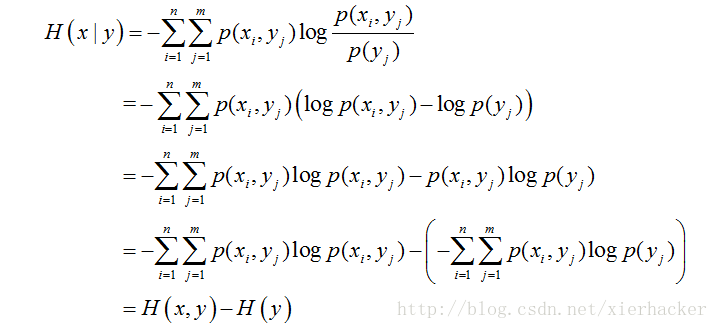

条件熵:

9 m# A: [. ~% y o

9 m# A: [. ~% y o

| 欢迎光临 数学建模社区-数学中国 (http://www.madio.net/) | Powered by Discuz! X2.5 |