数学建模社区-数学中国

标题: 机器学习笔记十:各种熵总结(二) [打印本页]

作者: 重光兰衣 时间: 2018-11-1 10:22

标题: 机器学习笔记十:各种熵总结(二)

机器学习笔记十:各种熵总结(二)二.相对熵相对熵又称互熵,交叉熵,鉴别信息,Kullback熵,Kullback-Leible散度(即KL散度)等。 1 b; H+ z8 J) i& u: i

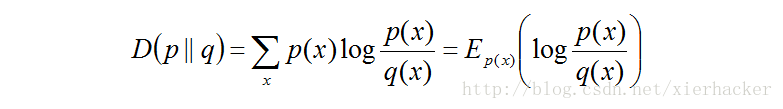

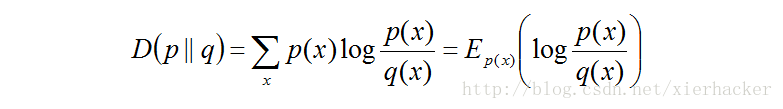

设p(x)和q(x)是取值的两个概率概率分布,则p对q的相对熵为:

: [$ r3 E" I8 W/ D- B3 {' @

: [$ r3 E" I8 W/ D- B3 {' @

在一定程度上面,相对熵可以度量两个随机变量的距离。也常常用相对熵来度量两个随机变量的距离。当两个随机分布相同的时候,他们的相对熵为0,当两个随机分布的差别增大的时候,他们之间的相对熵也会增大。

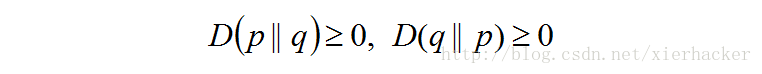

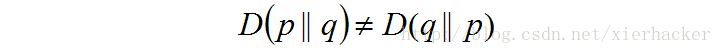

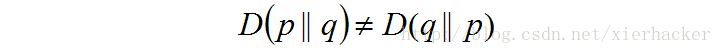

, i( Z7 p9 C5 I: |; @但是事实上面,他并不是一个真正的距离。因为相对熵是不具有对称性的,即一般来说  相对熵还有一个性质,就是不为负。9 X' W+ }, }# S @

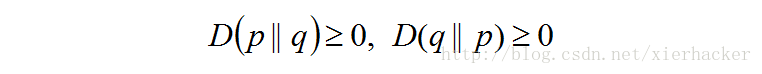

相对熵还有一个性质,就是不为负。9 X' W+ }, }# S @

% P* K8 {* p. @9 _+ I: ^1 Z三.互信息. y' N1 A' |' K: R% m

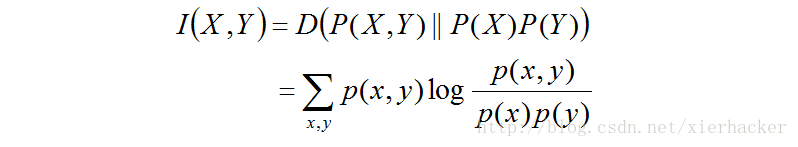

互信息(Mutual Information)是信息论里一种有用的信息度量,它可以看成是一个随机变量中包含的关于另一个随机变量的信息量,或者说是一个随机变量由于已知另一个随机变量而减少的不确定性。

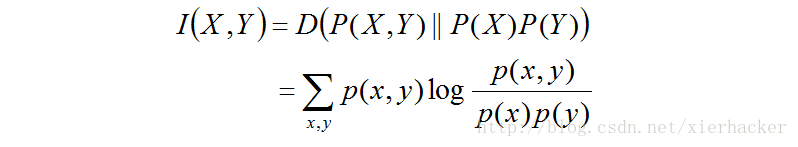

1 t: a( k4 H f3 t9 z& F两个随机变量X,Y的互信息,定义为X,Y的联合分布和独立分布乘积的相对熵。 0 L: w6 F1 x7 {! l2 O: k

! W$ k& D$ B( d7 q6 h3 `" X1 R2 @: B6 v1 I

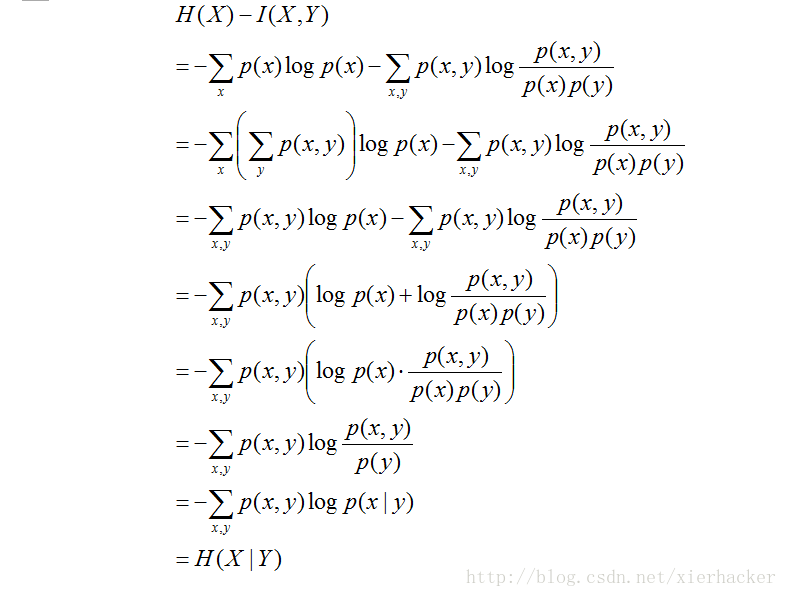

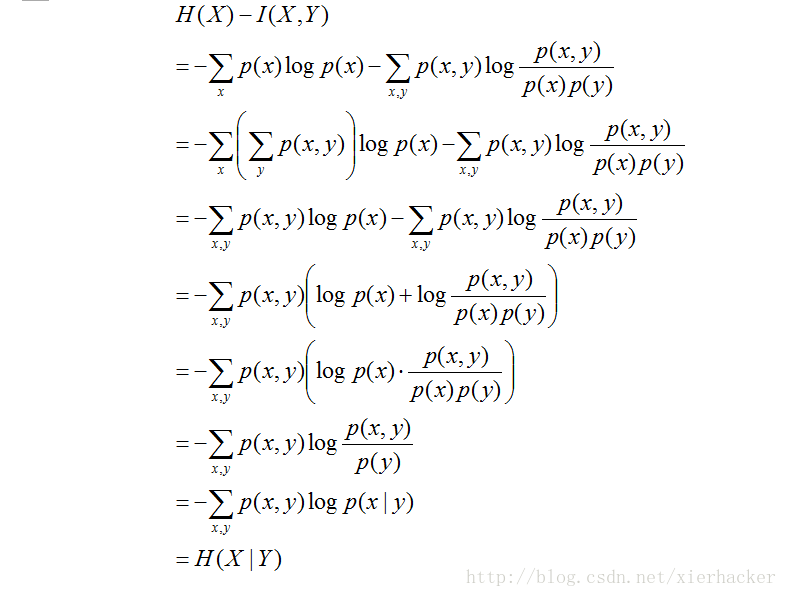

那么互信息有什么更加深层次的含义呢?首先计算一个式子先:

; J8 Q3 [! f1 h m: V

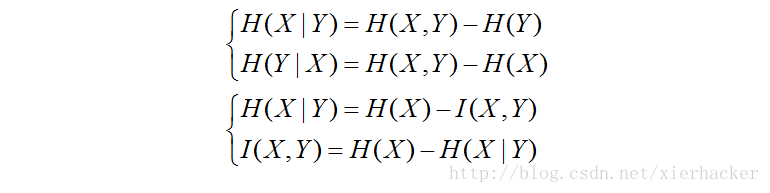

! w. r% l- o+ D2 `5 ]: g# E从这个公式可以知道,X的熵减去X和Y的互信息之后,可以得到在Y给定的情况下X的熵。

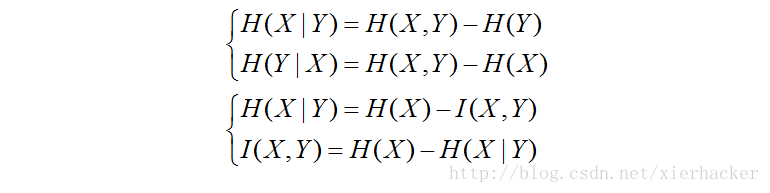

四.总结

7 X! s" ]: l2 {: O8 L/ V' @% C

; s$ t/ n- O8 j. n; b8 @! y2 I* l$ d

$ I% G8 |# u) I4 ?( @

& U) }) H+ R/ K& @- q3 { r

| 欢迎光临 数学建模社区-数学中国 (http://www.madio.net/) |

Powered by Discuz! X2.5 |

: [$ r3 E" I8 W/ D- B3 {' @

: [$ r3 E" I8 W/ D- B3 {' @ 相对熵还有一个性质,就是不为负。9 X' W+ }, }# S @

相对熵还有一个性质,就是不为负。9 X' W+ }, }# S @